NVIDIA veut multiplier les performances du path tracing par… un million !

NVIDIA explique que ses futures architectures GPU pourraient multiplier les performances du path tracing par un million par rapport à Pascal.

NEWS

NVIDIA vise un bond de 1 000 000× en path tracing

Source : wccftech.com

#Nvidia #PathTracing #hardwarePC

NVIDIA a profité de la GDC 2026 pour montrer jusqu’où elle compte pousser le path tracing dans les années à venir !

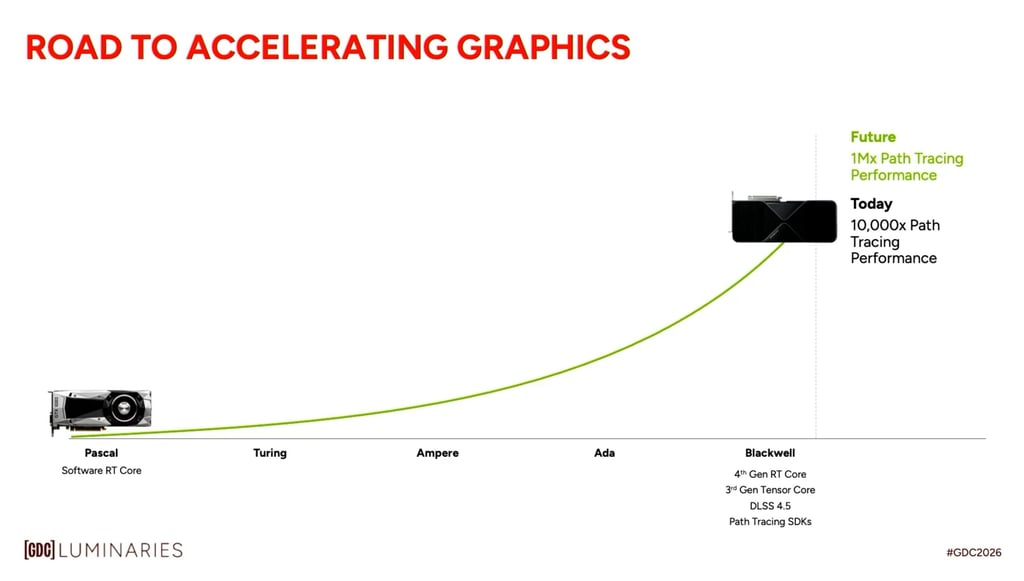

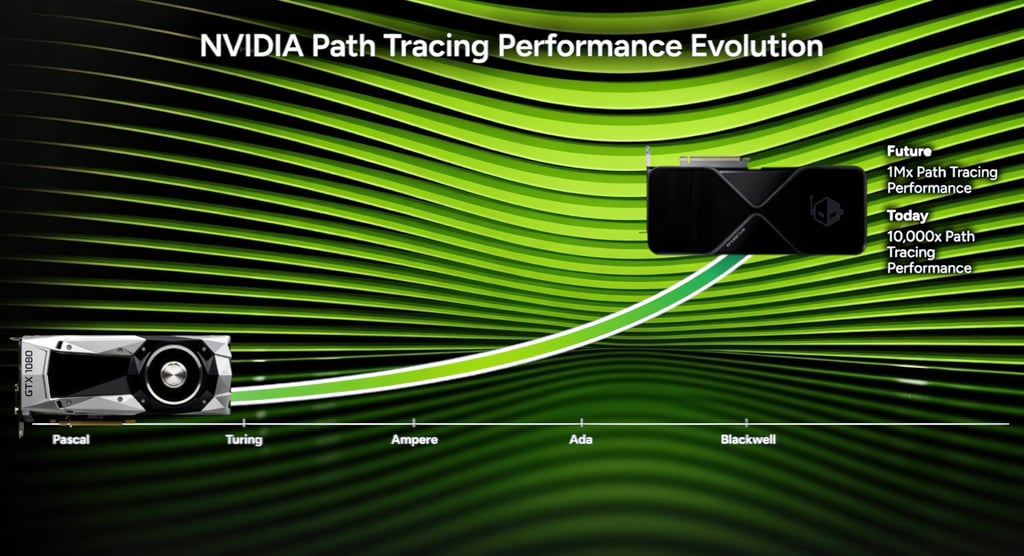

Selon John Spitzer, responsable des technologies développeurs chez NVIDIA, les GPU actuels offrent déjà 10 000× plus de performances en path tracing que les GeForce GTX 10 basées sur l’architecture Pascal, sortie en 2016. Mais pour NVIDIA, ce n’est qu’un début !

L’entreprise vise à terme un gain total de 1 000 000× par rapport à Pascal, possiblement avec la future architecture Rubin, attendue autour de 2027-2028 !

Le problème, c’est que la loi de Moore ne suffit plus ! Pendant longtemps, cette règle de l’industrie expliquait que la puissance des puces doublait tous les deux ans grâce à l’augmentation du nombre de transistors. C’est ce qui a permis aux GPU et aux CPU de progresser très vite pendant des décennies. Mais aujourd’hui, ces gains sont beaucoup plus difficiles à obtenir simplement en fabriquant des puces plus petites et plus rapides !

John Spitzer l'explique ainsi :

« Voici notre série GTX 10 basée sur Pascal, lancée en avril 2016, il y a presque exactement dix ans. Si vous regardez les performances à l’époque avec uniquement un ray tracing logiciel et que vous comparez à aujourd’hui, nous disposons désormais de RT Cores de quatrième génération, de Tensor Cores de troisième génération et de DLSS 4.5 capable d’inférer 23 pixels sur 24.

Ces technologies se multiplient entre elles. En les combinant avec les algorithmes, nous avons obtenu une amélioration d’environ 100 fois du nombre de rayons utilisés, pour un gain total d’environ 10 000 fois en performances au cours des dix dernières années.

Mais nous n’en sommes toujours pas là où nous voulons être. Nous voulons que les images en temps réel soient impossibles à distinguer de la réalité, comme dans un film.

Si nous comptions uniquement sur la puissance brute, ce ne serait pas possible. La loi de Moore est morte. Nous ne verrons pas une amélioration de 100× du silicium de mon vivant. Nous devrons donc compter sur l’ingéniosité algorithmique et sur l’IA pour combler l’écart entre le rendu temps réel dans les jeux et le rendu cinéma. »

NVIDIA mise donc sur une autre approche : combiner matériel spécialisé, algorithmes et intelligence artificielle. C’est en effet ce mélange qui a permis l’arrivée des RT Cores, des Tensor Cores, du DLSS, et plus récemment de DLSS 4.5, capable d’inférer une grande partie des pixels de l’image.

Et la firme continue aussi de développer de nouvelles technologies pour améliorer le rendu.

Par exemple ReSTIR, un algorithme qui permet de simuler plus efficacement la propagation de la lumière dans une scène, ou encore RTX Mega Geometry, conçu pour gérer des environnements très complexes avec énormément de détails.

En parallèle, l’écosystème DLSS continue de s’étendre rapidement. NVIDIA indique que plus de 800 jeux supportent désormais la technologie, et que la grande majorité des joueurs l’activent lorsqu’elle est disponible.

La société prévoit aussi d’introduire DLSS 4.5 avec Multi Frame Generation 6×, capable de générer jusqu’à six images supplémentaires par image rendue, ainsi qu’un mode dynamique adaptant automatiquement la génération d’images selon la charge et la fréquence d’affichage.